728x90

반응형

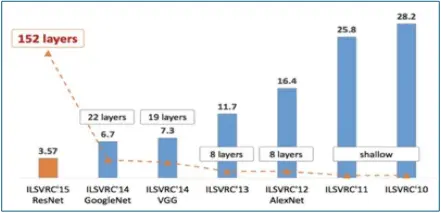

ILSVRC (Image Large Scale Visual Recognization Challenge)

- 2012년도부터 DNN(Deep Nueral Network)를 사용하면서 성능이 비약적으로 증가됨 -> Deep Learning의 Boom 시작

- 이후 Layer 수가 증가하면서 VGG, GoogleNet, ResNet이 등장하면서 발전

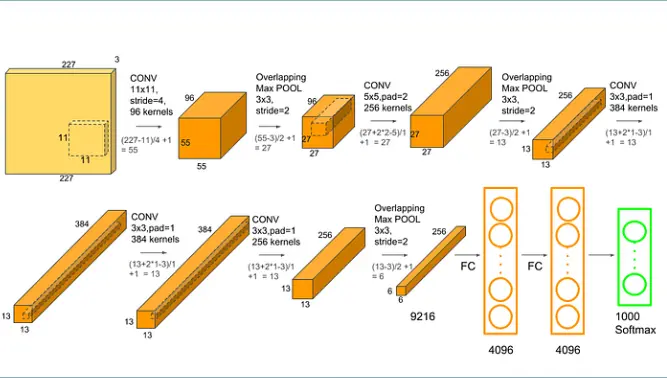

AlexNet

이미지 분야에서 Deep Learning의 Boom을 일어낸 알고리즘

- 약 84%의 성능

AlexNet의 특징

- 최초로 CNN Layer를 deep하게 구성(5개)

- 이미지 분야에서 최초로 ReLU Activation function을 사용

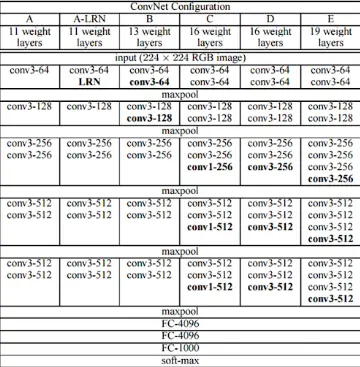

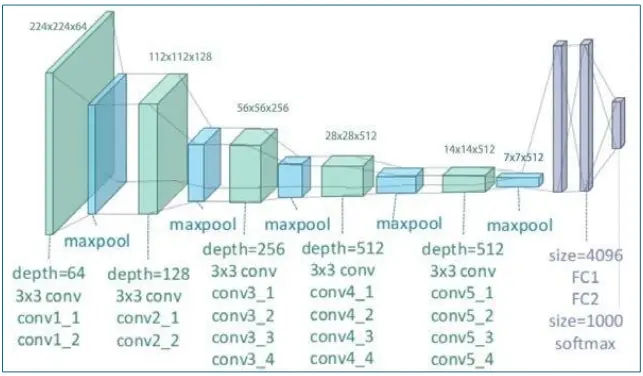

VGG - 19

- VGG -, 뒤에 붙은 숫자가 layer의 개수를 뜻함

- 약 93%의 성능

- Conv Layer를 19개로 구성

- 3x3 size의 Filter를 사용

- Filter의 크기가 작을수록 feature map의 크기가 유지됨

- feature map의 크기가 유지되기 때문에 Conv Layer를 더 깊게 쌓을 수 있음

- 3x3 size부터 feature extraction이 가능

- 추출한 feature map의 개수가 AlexNet의 2배, 때문에 모델의 성능도 더 뛰어남

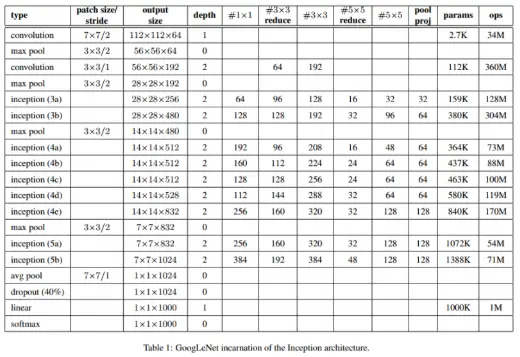

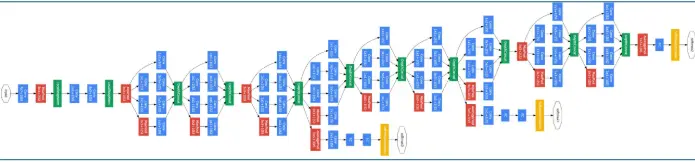

GoogLeNet (Inception)

- 2014년도에 우승한 알고리즘 (약 93% 정확도)

- Google에서 개발

- LeNet의 Inception block을 활용

- 22개의 Conv Layer로 구성

- 3개의 Softmax함수, 출력 3개

- Transfer leanring(전이 학습)을 사용

- 추론 시, softmax2 사용

- Gradient 소실을 방지하기 위해 나머지 Softmax함수로 방지(추론 후 $w$ 업데이트)

- 3x3 kernal

- Inception block에 들어가기 전, Nomalization을 거침

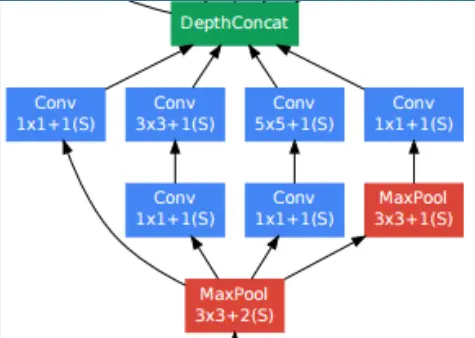

GoogLeNet - Inception block

- 1x1 kernel(Turtle Neck)은 실제로는 연산X

- feature map의 각 feature를 활성/비활성 시키는 역할

- 3x3, 5x5 두 kenel로 두 개의 feature map을 추출 후 병합

- 병렬로 수행

- Inception 모듈의 반복

GoogLeNet –V2

VGG에서 영감을 받아 기존 5x5 크기의 kernel을 3x3크기의 kernel 2개로 변경

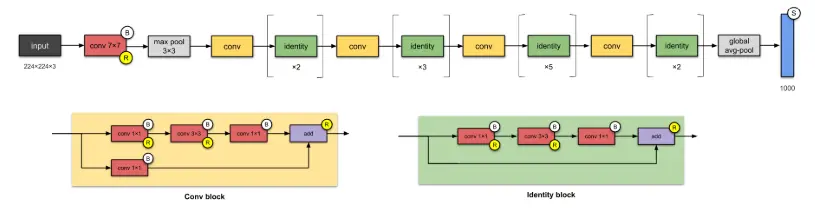

ResNet (2015)

Image Classification 분야를 종결시킨 알고리즘

- Batch Normalization 사용

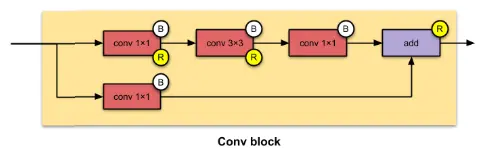

Conv block

- VGG의 3x3 kernel만 사용

- GoogLeNet에서의 Turtle Neck 차용(병렬 처리, 연산량 감소)

- Conv layer에서 ReLU 사용

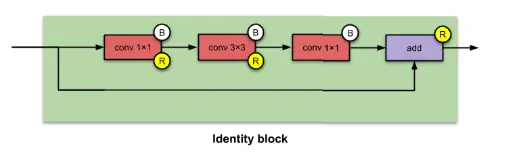

Identity block

- Conv 연산한 feature와 이전의 feature를 Concat -> Skip Connection

- Skip Connection을 통해 기울기소실 문제 해결

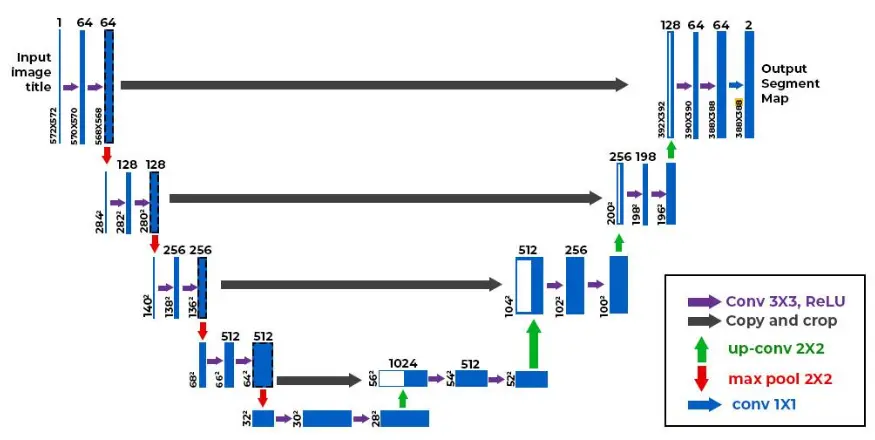

U - Net

- Conv 3x3 layer사용

- up-sampling 과정에서 Skip-Connection을 차용, 병렬처리(기울기 소실 해결)

- Auto-Encoder와 비슷한 구조

위 알고리즘들이 주는 교훈

AlexNet(2012)

Conv layer를 깊게 쌓자! (Deep Learning)

VGG (2014)

Conv layer의 kerenl 크기를 3x3로 설정하는 것이 좋다! (feature map의 크기 유지 -> 더 깊은 Conv layer)

GoogLeNet (Inception, 2014)

Conv layer를 병렬로 처리하자! (3x3 kernel보다 이미지의 해상도 줄이는 데 더 효과적. 다만, 기울기소실 문제 발생)

출처: [성균관대 컨소시엄] 건양대 DNA School 기초과정 - 병원 임상데이터를 활용한 AI기초 강의자료

728x90

반응형

'Data Science > ML & DL' 카테고리의 다른 글

| 이미지를 위한 인공지능, CNN (0) | 2024.07.10 |

|---|---|

| 인공지능을 위한 평가방법 Mextics(Accuracy, Confusion Matrix, ROC, AUC (0) | 2024.07.09 |

| 딥러닝의 원리와 확장성 (0) | 2024.07.08 |

| 선형(Linear) 문제 (0) | 2024.07.07 |

| 기계학습의 종류 (1) | 2024.07.05 |